精選解讀|Sam Altman 專訪揭露 OpenAI 新排序:AI 競爭正從模型與產品,轉向算力配置、國家合作與治理責任

精選解讀|Sam Altman 專訪揭露 OpenAI 新排序:AI 競爭正從模型與產品,轉向算力配置、國家合作與治理責任

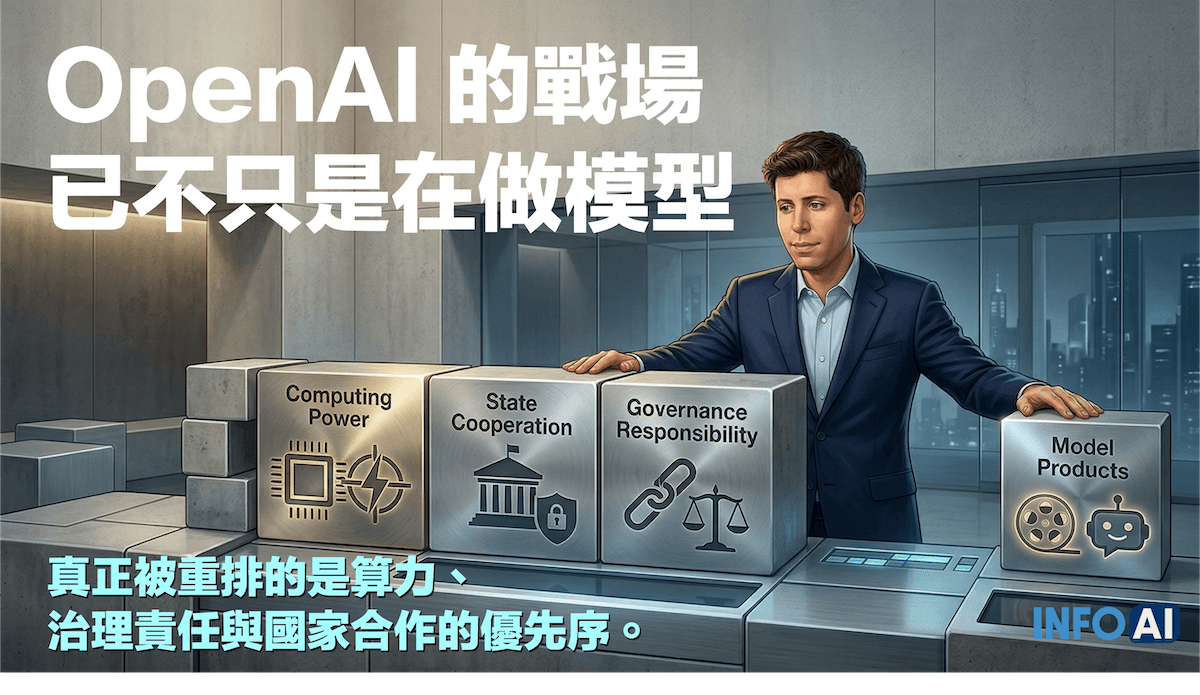

這場《Mostly Human》專訪真正值得看懂的,不是 Sam Altman 又談了哪些未來想像,而是 OpenAI 已把優先順序從功能擴張,轉向更少數、但更高槓桿的任務。這背後牽動的,已不只是產品路線,也包括政府關係、社會韌性與權力邊界。

當一家 AI 公司開始談土地、電力、國安與社會契約,它就已經不只是產品公司。

從 2025 年底到 2026 年春天,OpenAI 連續釋出的幾個訊號,放在一起看,比任何一次產品發表都更值得管理層注意。表面上看,這些事件彼此分散:Disney 一度高調投資 OpenAI、授權角色給 Sora 與 ChatGPT Images 使用;幾個月後,Sora 又傳出停止;另一邊,Anthropic 與美國國防部因合作條件發生衝突,OpenAI 則選擇進入合作框架,並由 Sam Altman 親自出面辯護。

但如果把這些事件放回同一張圖裡,你會看到一個更大的轉向:AI 產業現在競爭的,已經不只是模型能力,也不只是誰的產品更吸睛,而是誰能把算力配置、產品容量、代理系統、政府合作邊界與治理責任,整成一套可持續運作的秩序。

關鍵解讀:

OpenAI 這場轉向最值得注意的,不是它停掉了某個高話題性的產品,而是它願意讓高曝光、高想像力的產品線退居後位,把稀缺資源留給它判定更核心的方向。這代表領先 AI 公司的管理問題,正在從「做出更多功能」,轉向「在有限資源下,哪些能力最值得被保留」。而當一家公司開始同時處理政府、國安、公共信任與社會後果,它的競爭位置也已不再只是技術供應商,而更接近一個基礎設施型平台。

從 2025 年底到 2026 年春天,OpenAI 連續釋出的幾個訊號,放在一起看,比任何一次產品發表都更值得管理層注意。表面上看,這些事件彼此分散:Disney 一度高調投資 OpenAI、授權角色給 Sora 與 ChatGPT Images 使用;幾個月後,Sora 又傳出停止;另一邊,Anthropic 與美國國防部因合作條件發生衝突,OpenAI 則選擇進入合作框架,並由 Sam Altman 親自出面辯護。

但如果把這些事件放回同一張圖裡,你會看到一個更大的轉向:AI 產業現在競爭的,已經不只是模型能力,也不只是誰的產品更吸睛,而是誰能把算力配置、產品容量、代理系統、政府合作邊界與治理責任,整成一套可持續運作的秩序。

關鍵解讀:

OpenAI 這場轉向最值得注意的,不是它停掉了某個高話題性的產品,而是它願意讓高曝光、高想像力的產品線退居後位,把稀缺資源留給它判定更核心的方向。這代表領先 AI 公司的管理問題,正在從「做出更多功能」,轉向「在有限資源下,哪些能力最值得被保留」。而當一家公司開始同時處理政府、國安、公共信任與社會後果,它的競爭位置也已不再只是技術供應商,而更接近一個基礎設施型平台。

Sora 的退場,透露的是算力排序,不只是產品取捨

如果只把 Sora 的停止看成一則產品新聞,很容易低估它的訊號強度。更值得注意的是,這件事發生在高曝光合作之後。原本被外界視為生成式 AI 進入娛樂工業的重要一步,最後卻沒有留在 OpenAI 內部的最高優先順位。

這裡真正重要的,不是「影片生成有沒有價值」,而是「影片生成在當下,是否足以贏過其他更核心的能力層」。對 OpenAI 來說,這看起來已經不是一個單純的產品選擇,而是一個更像基礎設施公司的資源分配決定。

值得我們思考的是,當算力、推論容量、資料中心、電力與高階人才都很緊時,管理問題就不再是「還能不能再做一個功能」,而是「什麼最值得佔用這些資源」。Sora 的退場,不一定代表影片生成賽道失去意義;更準確地說,它代表 OpenAI 認為,這條能力在現階段還不足以與其他更核心方向爭奪同一批算力與組織注意力。

對企業決策者而言,這是一個很實際的提醒:未來領先 AI 公司的路線圖,不只是產品藍圖,而是稀缺基礎設施的優先順序表。你看到的每一項新功能,背後其實都在競爭同一份容量。

這場專訪真正透露的,是 OpenAI 想把資源押在哪一種未來

《Mostly Human》這場專訪真正值得讀的,不是哪一句未來感十足的語錄,而是它把 OpenAI 想押注的未來輪廓講得更清楚了。

Altman 談到的幾個方向,包括一人規模公司在 AI 代理支援下可能達到極高估值、AI 研究員可能加速科學突破、AI 對就業與分配機制的衝擊等。這些表面上像是對未來的想像,實際上更像是對下一波資源配置的提示。它們共同指向的,不是更多內容生成,而是更強的代理能力、更深入的任務接手,以及更高階的流程替代。

如果再把 OpenClaw 創辦人 Peter Steinberger 加入 OpenAI 這件事放進來看,輪廓就更完整了。OpenAI 現在押注的,不只是讓模型更會回答問題,而是讓 AI 更能執行任務、承接流程、在知識工作鏈條中直接產生結果。

這也是為什麼「一人十億美元公司」不該被當成一句勵志口號。比較穩當的理解是,Altman 在描述一種組織形態可能被壓縮的未來。在這個未來裡,原本需要大量功能角色維繫的流程,會有一部分被代理系統接走;於是最稀缺的資源,不再只是人力,而會慢慢轉向品牌、法務、資料存取權、分發入口與資本承擔能力。

公司不一定會先變大,但很可能先變小。這不是管理層可以用想像力來面對的議題,而是要開始重新盤點組織邊界的議題。

Anthropic 與 OpenAI 的分歧,反映的是 AI 公司與國家的新關係

這場專訪最敏感、也最具結構性的部分,不是 Sora,而是美國國防部。

Anthropic 選擇拒絕部分條件,把紅線先畫清楚;OpenAI 則選擇進入合作框架,在制度內協商。很多人會想把它簡化成「誰比較有原則、誰比較現實」,但這樣的理解太快了。從目前可見資料來看,更合理的判讀是:兩家公司採取了兩種不同的政府合作策略。

一種做法,是先把不能碰的邊界公開化,哪怕因此與政府正面衝突;另一種做法,則是先進入體制,再在體制內協商自己的位置。前者把爭議前置,後者把爭議內部化。兩種策略都不是中性的,也都各自帶著風險。

真正改變的,是大型 AI 公司已經很難再維持「我只是技術供應商」的姿態。當模型能力開始碰到國安、網安、生物安全與公共基礎設施,政府與 AI 平台之間的關係,就不再只是監管,而會愈來愈像一種協作、制衡與相互依賴交錯的混合體。

這也是為什麼 Altman 的說法會引發爭議。因為它碰到一個很難回避的問題:如果國家安全系統拿不到最先進模型,國家會不會用更粗糙、更失控的方式介入;但反過來,如果最先進模型主要由少數公司供應,這些公司是否也會在國家治理中取得過大的議價能力。

這不是一句「民主監管」就能結束的討論,而是未來數年所有大型 AI 平台都得面對的結構問題。

Sam Altman 的角色,正在從創辦人轉向基礎設施時代的談判者

這場專訪的重要性,不只在內容,也在角色變化。

你如果回頭看 Altman 近一段時間面對的議題,會發現焦點早就不只剩產品。從親職、教育、社會影響,到政府合作、國安、公共信任、資源配置與權力責任,這些主題放在一起,已經不是一般科技創辦人慣常要處理的範圍。

從企業治理的角度看,這非常關鍵。因為當一家公司的瓶頸不再只是技術突破,而是晶片、電力、資料中心、跨國合作與制度合法性,執行長最核心的任務也會跟著改變。過去矽谷創辦人最被看重的是產品直覺、速度與冒險精神;現在大型 AI 公司的執行長,卻愈來愈像在處理公共建設、地緣政治與社會信任的綜合型談判者。

把 Altman 稱為「政治家型執行長」,比較適合作為分析判讀,而不是事實標籤。但這個判讀之所以成立,不是因為他自稱如此,而是因為他的工作內容、公開論述與外部責任,已經愈來愈接近制度協商者。

當你的產品會碰到學習、工作、政府與暴力系統,你就不再只是賣工具。你會被要求回答更難的問題:哪些用途不該做、哪些合作應該拒絕、哪些風險應先由公司承擔、哪些部分又必須交還給公共制度。這類問題,才是基礎設施時代真正的經營題。

這可能不只是前瞻,也可能是敘事升級後的自我修正

真正成熟的判讀,不該只有一個方向。

Altman 現在講得更像公共人物,不代表 OpenAI 已經解決了這些問題。也可能只是因為公司體量更大、監管壓力更高、外部不信任更深,所以他必須用更成熟的語言,包裹一個仍未定型的商業與治理現實。

Sora 的停止,不一定只代表高明聚焦,也可能代表戰線過長後的被迫收縮;與國防部合作,不一定代表更負責,也可能只是更接近權力核心。這些疑問,目前都沒有被完全消除。

這個反方視角很重要,因為它提醒我們,不要把 AI 公司的每一次戰略調整都自動解讀成前瞻佈局。今天用「算力有限」為理由重排產品優先序,明天也可能因為競爭壓力、地緣政治或資本要求,再次改變排序。

到目前為止,真正被證明的只有一件事:AI 的能力邊界、社會邊界與政治邊界,已經不能分開談了。它們正在被迫同步協商。

這也可能只是敘事升級,而不是產業答案已定

Altman 現在講得更像公共人物,不代表 OpenAI 已經解決了這些問題。相反地,也可能只是因為公司體量更大、監管壓力更高、外部疑慮更深,所以他不得不用更成熟的語言,去包裹仍未定型的商業與治理現實。Sora 的停止,不一定只代表高明聚焦,也可能代表 OpenAI 先前戰線拉得太長;與國防合作,不一定代表更負責,也可能只是更靠近權力核心。這些疑問,目前都還存在。

這個觀點值得保留,因為它提醒我們,不要把所有戰略取捨自動解讀成前瞻。AI 公司今天可以用「算力有限」為理由重排產品優先級,明天也可能因為市場競爭、地緣政治或資本壓力,再次改變排序。Anthropic 與 OpenAI 走向兩種不同作法,也不代表哪一方已被歷史證明正確。到目前為止,真正被證明的只有一件事:AI 的能力邊界、社會邊界與政治邊界,正在被迫同步談判。

對企業真正有用的,不是追逐熱門功能,而是看懂供應商的真實優先序

這篇解讀文章如果只停在 OpenAI 與 Anthropic 的競爭,那它就只是產業新聞。真正對企業有用的,是把這些事件轉成一套可操作的判讀框架。

對企業來說,這場專訪最重要的提醒,不是去追問「下一個 Sora 在哪裡」,而是學會看懂 AI 供應商真正把什麼排在前面。未來不管你是金融、製造、零售、媒體,還是大型服務業,真正會決定合作穩定性的,未必是最吸睛的展示功能,而是那家供應商在算力緊張、法規升高或安全條件變動時,會先保哪一條產品線、先滿足哪些客戶、先服務哪些戰略目標。

如果你是 CIO、數位長或採購主管,至少要先問三個問題。

第一,這項能力對供應商來說,到底是核心產品,還是邊緣能力。

第二,如果算力、法規或安全條件改變,供應商會先保護哪一層服務。

第三,這個系統的價值,主要來自模型本身,還是來自代理流程、資料整合與治理能力。

這三題會直接影響你的合約長度、導入深度、備援策略與退出成本。

如果你是媒體、電商或客服部門主管,還要再多問一題:你現在買到的,到底是核心能力,還是展示功能。生成式影音、品牌素材生成、客服代理、程式代理,看起來都很亮眼,但它們在平台內部的戰略順位可能完全不同。如果你把整段流程深度綁在一個對供應商而言並非最高優先的能力層上,未來一旦方向調整,你要承擔的就不只是功能下架,而是整個流程必須重做。

如果你是法務、風控或董事會成員,還要再看另一層:供應商與政府的關係。未來大型 AI 平台與國家安全體系之間的連動,只會更緊,不會更鬆。這不代表你該排斥大型平台,而是你必須事先問清楚:資料邊界在哪裡、能力如何升級、事件發生時誰負責通知、哪些功能可能因政策調整而改變。

比起被一場產品發表會說服,這些問題更值得先問。

總結|OpenAI 的新排序,提醒管理層重新理解 AI 競爭的單位

這場專訪真正揭露的,不只是 OpenAI 的策略轉向,而是 AI 產業的競爭單位,已經從模型與產品,轉向更上層的資源排序、制度位置與治理能力。

第一,AI 競爭的基本單位,正在從模型能力轉向系統優先序。這場專訪最值得讀的,不是幾句未來想像,而是 OpenAI 願意讓高曝光產品線退居後位,顯示它開始用更像基礎設施公司的方式管理資源。

第二,AI 公司與國家的關係,正從監管問題轉向權力配置問題。Anthropic 與 OpenAI 的差異,不只是商業策略差異,而是對「高階 AI 能力應該如何進入國家體系」的不同回答。

第三,對決策者而言,最值得持續觀察的指標,不是哪家公司又發佈了什麼新模型,而是哪一家平台在算力吃緊、政策升高或風險擴大時,會先保住哪些能力、砍掉哪些能力、優先服務哪些對象。這才是真正能反映一家 AI 供應商戰略排序的訊號。

最後要回到組織內部問自己的,不是「這個功能看起來厲不厲害」,而是「我們現在導入的,究竟是一個好用功能,還是一個未來三年仍會被平台視為核心的能力層?」這兩者的風險結構,完全不同。

FAQ:

Q1|Sam Altman 這場《Mostly Human》專訪,真正的新訊號是什麼?

真正的新訊號,不是他又描繪了哪些未來願景,而是 OpenAI 已明顯把競爭重心從功能擴張,轉向算力分配、代理系統、政府合作與治理責任。從文章裡整理的事件脈絡來看,這種轉向不是單一發言,而是由多個事件共同支撐:Sora 的退場、企業代理服務的推進、與政府合作的表態,以及對組織型態未來的重新描述。

對企業而言,最重要的意義是:未來看 AI 公司,不能只看模型能力與功能發表,而要看它真正把什麼排在最高優先序,因為那會直接影響你導入後的穩定性、供應承諾與風險承擔。

Q2|OpenAI 停止 Sora,是否代表影片生成 AI 已經失去價值?

不是。比較合理的理解是,這比較像資源重新排序,而不是影片生成整體失去價值。這篇文章真正指出的重點在於:如果連高曝光、大型合作背書的產品線,都可能在平台內部重新排序時退居後位,那企業更該在意的,就不是功能本身炫不炫,而是這條能力在供應商內部到底排第幾順位。

換句話說,影片生成未必不重要,但它可能還不夠重要,至少不足以在某個時間點贏過 OpenAI 認為更核心的能力層。這對企業採購與流程設計的影響,比單一產品新聞更大。

Q3|Anthropic 與 OpenAI 對美國國防部的不同選擇,代表什麼?

它代表大型 AI 公司已經不能只把自己定位成中立技術供應商,而必須回答自己與國家權力的關係。文章中整理的差異很清楚:Anthropic 傾向先畫紅線,把不能接受的用途講清楚;OpenAI 則選擇進入合作框架,在制度內部協商位置。

這不是簡單的道德高下,而是兩種不同的治理策略。對董事會、法務長與資安主管來說,真正的實務意義在於:你選的不只是模型供應商,而是它背後的治理哲學、政治風險承擔方式,以及未來在政策變化下的合作穩定性。

Q4|Altman 提到的「一人十億美元公司」,應該怎麼理解?

比較穩妥的理解,不是把它當成已普遍發生的商業事實,而是把它看成對組織壓縮趨勢的描述。文章已把重點拉得很清楚:這句話真正有價值的地方,不在估值神話,而在於它指出代理系統可能會接走愈來愈多流程性工作,進而改變公司的最小有效規模。

對創業者與中小企業主來說,這不代表未來只要少數人就能自動成功,而是代表企業的瓶頸會重新分布。某些執行工作可能被壓縮,但品牌、信任、法務、分發與資本承擔能力,反而會變得更重要。

Q5|企業在採購 AI 平台時,最該先問哪幾個問題?

這篇文章已經整理出很實用的決策框架。第一,要問這項能力對供應商來說是核心產品還是邊緣能力;第二,要問當算力、法規或安全條件改變時,供應商會先保哪一層服務;第三,要問這個系統的價值主要來自模型本身,還是來自代理流程、資料整合與治理能力。

這三題之所以重要,是因為它們會直接影響導入後的穩定性、合約設計、備援策略與退出成本。企業不是只在買一個當下可用的功能,而是在押注一個平台未來會不會持續把這個能力視為核心。這才是決策者真正該問的問題。

參考資料:

The Power and Responsibility of Sam Altman

- Veteran Tech Journalist And Mostly Human CEO Laurie Segall Sits Down Exclusively With OpenAI CEO Sam Altman

- Disney to invest $1 billion in OpenAI, license characters for Sora video tool

- OpenAI drops AI video tool Sora, startling Disney, sources say

- OpenAI to cut back side projects to focus on core business, WSJ reports

- Artificial Intelligencer: OpenAI's $852 billion problem: finding focus

- OpenAI unveils AI agent service as part of push to attract businesses

- Anthropic refuses Pentagon's new terms, standing firm on lethal autonomous weapons and mass surveillance

- Sam Altman says he 'miscalibrated' the mood of distrust toward AI and the government in the Pentagon deal

- OpenClaw's creator is heading to OpenAI. He says it could've been a 'huge company,' but building one didn't excite him.

閱讀推薦:

新聞速讀|OpenAI 執行長 Sam Altman 指出 Google 技術領先壓力升高,內部示警短期經濟逆風

精選解讀|Sam Altman 預測:AGI 有望於 2030 年前超越人類智慧

精選解讀|Sam Altman 警告:AI 機器人正在侵蝕社群媒體真實性,社群互動正走向陌生與混淆

深度報導|Sam Altman 正面挑戰馬斯克!Merge Labs 挾 AI 與基因療法顛覆腦機界面

GPT-5 後時代:Sam Altman 帶領 OpenAI 跨足搜尋、AI 硬體與腦機介面的全球戰略

GPT‑5 推出進入倒數,推理與寫程式能力大幅躍進,Sam Altman 一句話揭開序幕

解碼 Sam Altman 的未來十年藍圖:從超級智慧到一人公司崛起

超級智慧的黎明已至:Sam Altman的宣告,為何是現在必須讀懂的未來?

Sam Altman揭示AI藍圖:邁向超級智慧與全民普惠

「溫和奇點」來臨?Sam Altman 給你一個更真實的 AI 未來預言

Sam Altman 發文:AI Agent 將重塑世界經濟

DeepSeek R1 是什麼?為何連 OpenAI CEO Sam Altman 都稱讚?

新聞速讀|OpenAI 執行長 Sam Altman 指出 Google 技術領先壓力升高,內部示警短期經濟逆風

精選解讀|Sam Altman 預測:AGI 有望於 2030 年前超越人類智慧

精選解讀|Sam Altman 警告:AI 機器人正在侵蝕社群媒體真實性,社群互動正走向陌生與混淆

文/ 睿客

版權聲明與授權須知

本內容由 InfoAI 擁有著作權。如有引用、轉載或任何商業用途的需求,請來信聯絡: contentpower688@gmail.com。

如果你覺得這篇解讀對你有幫助,歡迎訂閱 InfoAI 電子報,我們將持續為你精選 全球 AI 新聞與趨勢洞察,幫助你看懂新聞背後的真正意義。也別忘了加入透過[按鈕]加入 Line 社群 ,隨時掌握值得關注的 AI 發展與專業觀點。

AI 協作聲明:

本篇文章由 InfoAI 團隊策劃,並透過人工智慧工具協助資料整理與內容撰寫,最終內容由編輯進行人工審閱與優化。

JUDGEMENT

We help you make better judgement about AI.

不是更快知道 AI 新聞,而是更早做出你能承擔後果的判斷。

InfoAI 存在的目的

是把 AI 的變化,轉換成可被理解、可被評估、可被行動的判斷框架。